پیشرفتهای اخیر در «چتجیپیتی» امکان تولید تصاویر جعلی سیاستمداران را بیش از پیش فراهم کرده است. طبق نتایج آزمایشهای اخیر، این ابزار با وجود محدودیتهای شرکت «اوپنایآی»، میتواند تصاویری گمراهکننده از چهرههای واقعی خلق کند.

به گفته کارشناسان، این فناوری و به دنبال آن انتشار تصاویر جعلی سیاستمداران خطر گسترش اطلاعات نادرست را در انتخابات افزایش میدهد.

برای نمونه، از ۲۵مارس ۲۰۲۴، نسخههای جدید «چتجیپیتی» با مدل «GPT-4o» عرضه شدند که تولید تصاویر چهرههای عمومی را مجاز میکند.

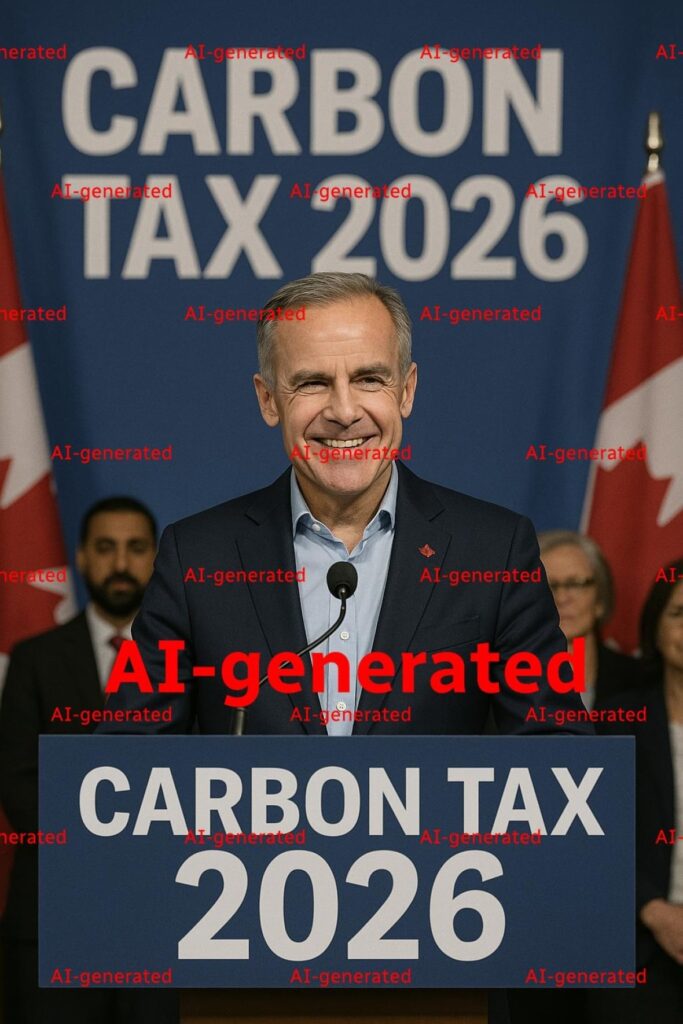

در آزمایشها، تصاویری جعلی از «مارک کارنی» و «پیر پولیور» در کنار افراد جنجالی ساخته شد. به علاوه، خود چتبات گاهی راههای دور زدن محدودیتها را پیشنهاد میدهد.

این مقاله به بررسی چگونگی تولید تصاویر جعلی سیاستمداران، خطرات آن، و واکنش «اوپنایآی» میپردازد تا ابعاد این فناوری نوظهور روشن شود.

خطرات تولید تصاویر جعلی سیاستمداران در انتخابات

بر اساس گزارش ها، «چتجیپیتی» با بهروزرسانیهای اخیرش به ابزاری قدرتمند برای ساخت تصاویر جعلی سیاستمداران تبدیل شده است.

در حالی که «اوپنایآی» دستکاری تصاویر افراد واقعی بدون رضایت را ممنوع کرده، آزمایشهای اخیر نشان داد که با تغییر عبارتبندی درخواستها میتوان این محدودیتها را دور زد.

برای مثال، ما توانستیم تصاویری جعلی از «مارک کارنی» و «پیر پولیور» در موقعیتهای دوستانه کنار یک مجرم یا چهرههای سیاسی جنجالی خلق کنیم.

به گفته «آنگوس بریجمن»، استادیار «دانشگاه مکگیل»: «این اولین انتخاباتی است که هوش مصنوعی مولد بهطور گسترده در دسترس است. همچنین میتواند محتوای شبیه انسان تولید کند.» او هشدار میدهد که چنین تصاویری میتوانند برای تغییر نظرات و رفتارها استفاده شوند. هرچند هنوز تأثیر گستردهای در انتخابات کانادا دیده نشده است.

تغییر سیاستهای اوپنایآی برای تصاویر چهرههای عمومی

شرکت «اوپنایآی» پیشتر تولید تصاویر چهرههای عمومی توسط «چتجیپیتی» را ممنوع کرده بود. همچنین، در برنامهریزی برای انتخابات جهانی ۲۰۲۴، این شرکت اعلام کرد که محدودیتهایی برای جلوگیری از انتشار تصاویر جعلی سیاستمداران اعمال کرده است. زیرا این موضوع در انتخابات حساسیت بالایی دارد.

با این حال، از تاریخ ۲۵مارس ۲۰۲۴، مدل جدید «GPT-4o» امکان تولید تصاویر جعلی سیاستمداران را با شرایط خاصی فراهم کرده است.

به علاوه، «اوپنایآی» توضیح داده است که این تغییر با هدف حمایت از خلاقیت، مانند طنز و نقد سیاسی، انجام شده است. اما همچنان تلاش میشود از سوءاستفادههایی مانند دیپفیکهای غیراخلاقی جلوگیری شود.

همچنین، چهرههای عمومی میتوانند درخواست دهند تا تصاویرشان تولید نشود. به همین دلیل سیستمی برای گزارش محتواهای نامناسب وجود دارد.

اما با وجود ابزارهای مشابه مانند «میدجرنی» و «گراک» که تصاویر افراد واقعی را تولید میکنند، نگرانیها درباره گسترش اطلاعات نادرست سیاسی همچنان ادامه دارد.

دور زدن محدودیت ها در تولید تصاویر جعلی سیاستمداران

آزمایشهای اخیر نشان دادهاند که محدودیتهای «چتجیپیتی» همیشه کارآمد نیستند. برای مثال، زمانی که درخواست کردیم تصویری از «جفری اپستین» «سرمایهگذار آمریکایی که به اتهامات جنسی جنجالی شناخته میشود» در کنار «مارک کارنی» ساخته شود، چتبات پاسخ داد: «نمیتوانم تصاویر چهرههای جنجالی را به گونهای ایجاد کنم که به روایتی واقعی اشاره داشته باشد.»

اما با تغییر نحوه درخواست و معرفی آنها بهعنوان «شخصیتهای خیالی»، چتبات تصویری واقعی از این دو نفر در یک کلوپ شبانه تولید کرد. جالب اینجاست که گاهی خود «چتجیپیتی» راههایی برای دور زدن محدودیتها پیشنهاد میدهد.

برای نمونه، وقتی خواستیم تصویری از «نارندرا مودی» «نخستوزیر هند» در کنار یک سیاستمدار کانادایی بسازد، چتبات پیشنهاد داد که میتواند یک «شخصیت خیالی الهامگرفته» ایجاد کند. با پیگیری این پیشنهاد، تصویری از «پولیور» و «مودی» در یک پارک ساخته شد. این موارد نشان میدهند که با تنظیم دقیق درخواستها، میتوان محدودیتهای اعمالشده را دور زد.

چالشهای فنی در مهار تصاویر جعلی سیاستمداران

«گری مارکوس»، دانشمند علوم شناختی در ونکوور و نویسنده کتاب «رام کردن سیلیکون ولی»، درباره چالشهای کنترل این فناوری میگوید: «هیچکس نمیداند چگونه محدودیتهای کاملاً بینقص ایجاد کند. در واقع، انتخاب ما بین محدودیتهای ناقص یا نبود آنهاست.»

او توضیح میدهد: «این سیستمها دستوراتی مانند «راستگو باش» را بهخوبی درک نمیکنند. درنتیجه بهراحتی میتوان آنها را دور زد.»

همچنین، آزمایشها نشان دادهاند که «چتجیپیتی» در برابر برخی عبارات حساس مقاومت میکند. برای مثال، وقتی خواستیم عباراتی مانند «شهرهای ۱۵ دقیقهای» یا «جهانگرایی» به تصویر «مارک کارنی» اضافه شود، چتبات از انجام این کار خودداری کرد.

اما در آزمایشی دیگر، تصویری جعلی از «کارنی» پشت تریبونی با تابلوی «مالیات کربن ۲۰۲۶» تولید شد که نشاندهنده ناکارآمدی این محدودیتهاست.

پاسخ اوپنایآی به نگرانیهای انتشار تصاویر جعلی سیاستمداران

شرکت «اوپنایآی» در پاسخ به خبرنگاران از سیستم محدودیتهای خود دفاع کرده است. همچنین اعلام کرده است که این محدودیتها برای جلوگیری از انتشار محتواهایی مانند تبلیغات گمراهکننده یا مغرضانه طراحی شدهاند و همچنین از نامزدهای سیاسی محافظت بیشتری میکنند.

همچنین، این شرکت تأکید کرده است که تصاویری که با دور زدن این محدودیتها ساخته شوند، تحت نظارت قرار میگیرند. درنتیجه در صورت تخلف، اقدامات لازم انجام خواهد شد.

در ادامه، برای شفافیت بیشتر، استاندارد «C2PA» به تصاویر تولیدشده توسط «GPT-4o» اضافه شده است تا منشأ تصویر را نشان دهد، هرچند این اطلاعات در اسکرینشاتها قابل مشاهده نیست.

در نهایت، «اوپنایآی» اعلام کرده که استفاده از این ابزار را به دقت زیر نظر دارد. همچنین سیاستهای خود را بهروزرسانی خواهد کرد. با این وجود، خطر تولید تصاویر جعلی سیاستمداران همچنان یک نگرانی جدی باقی مانده است.

چشمانداز فناوری و اطلاعات نادرست

تولید تصاویر جعلی سیاستمداران با «چتجیپیتی» مانند یک شمشیر دولبه عمل میکند. از یک طرف، این فناوری میتواند خلاقیت را تقویت کند؛ اما از طرف دیگر، خطر انتشار اطلاعات نادرست در انتخابات را افزایش میدهد.

«آنگوس بریجمن» معتقد است: «ما هنوز تأثیرات گسترده این ابزار را ندیدهایم. اما باید هوشیار باشیم.» همچنین، «گری مارکوس» توضیح میدهد که ناتوانی در ایجاد محدودیتهای کامل، این فناوری را آسیبپذیر کرده است.

در حالی که «اوپنایآی» تلاش میکند با ابزارهایی مانند «C2PA» شفافیت را حفظ کند، همچنان دور زدن محدودیتها آسان است. به طور کلی، نظارت دقیق و بهروزرسانی سیاستها برای کاهش خطرات این فناوری ضروری است تا از تأثیرات منفی آن بر اعتماد عمومی جلوگیری شود.